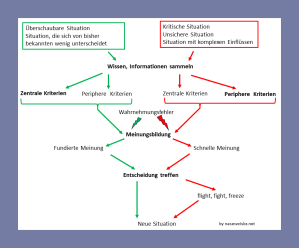

Gute Entscheidungen setzen ausreichendes Wissen voraus. Fundiertes Wissen ist die Basis der Demokratie. Aber wie gelangen Menschen zu diesem Wissen und treffen Entscheidungen, insbesondere bei sehr komplexen Themen?

Zum besseren Verständnis vereinfacht

Evolution – Basis für Ad hoc Entscheidungen

Der Mensch ist mit seinen tierischen Vorfahren noch eng verwandt – auch in Bezug darauf, wie er Entscheidungen trifft. Evolutionär waren meist schnelle Entscheidungen gefordert, die über Leben und Tod entschieden. Es blieb keine Zeit, alle erforderlichen Details zu analysieren.

Anstatt zentrale Punkte, die sich konkret auf die Situation beziehen, werden bei schnellen Entscheidungen (oder komplexen Situationen) bevorzugt periphere Punkte für Entscheidungen herangezogen. Diese Punkte haben keinen direkten Bezug zu der Situation (dem Thema), sondern beziehen sich z. B. auf die Quellen der Information (etwa Glaubwürdigkeit von Erzählungen) oder bisherigen Erfahrungen in ähnlichen Situationen („Das hat mir schonmal geholfen“). Entscheidungen werden also aus dem Bauch heraus getroffen (Pi-mal-Daumen / Faustregeln, s.u.).

Wissen, Meinungen und Entscheidungen

Meinungen basieren auf Wissen oder Glauben. Aufgrund von Meinungen werden Entscheidungen getroffen. (*)

Wissen ist das, was ein Mensch im Laufe seines Lebens gelernt hat. Dies kann durch Anschauung, Nachahmung, Erzählungen, Anlesen, Erlebnisse u. ä. erfolgen. Wissen bedeutet nicht, dass dieses Wissen richtig ist.

(*) Im Folgenden wird von Entscheidungen gesprochen. Dies beinhaltet implizit auch Meinungen und Wissensbeschaffung.

Information – gefiltert und geformt

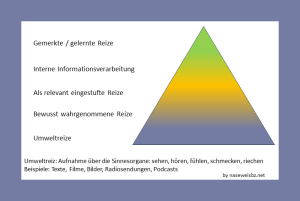

Wahrnehmung ist selten objektiv. Aufgenommene Informationen werden vom Gehirn gefiltert, bevor sie überhaupt bewusst werden. Ein wesentliches Kriterium, dass eine Information ins Bewusstsein dringt, ist deren Wichtigkeit / Relevanz.

Beispiel: In einem Experiment von Chabris / Simons sollten die Teilnehmer bei einem Baseballspiel 6 Spieler beobachten und die Pässe von 3 dieser Spieler zählen. Während des Spiels lief ein als Gorilla verkleideter Mensch über das Spielfeld. Der Gorilla wurde nur von einem sehr geringen Teil der Teilnehmer wahr genommen.

Nach der Selektion von Informationen finden weitere Informationsverarbeitungen statt: Wahrnehmungen werden vereinfacht, Zusammenhänge hergestellt, Informationen erneut selektiert etc.. Oft werden bei dieser Informationsverarbeitung „Faustregeln“ verwendet. Das ist besonders bei schnellen Entscheidungen, komplexen Inhalten oder oberflächlichen Recherchen der Fall. Es werden nicht alle Details der Situation analysiert, sondern nur „Eckpunkte“ geprüft (unter anderem anhand peripherer Kriterien).

Ein wichtiges Kriterium ist die Orientierung an Anderen: Was machen andere Menschen? Welche Meinung haben diese? Die vereinfachende Informationsverarbeitung führt zu verschiedenen Wahrnehmungsfehlern (Verzerrungen, engl. bias), die wiederum Entscheidungsfehler zur Folge haben (Details zu diesen beiden Punkten s. u.).

Home // Seitenanfang // Alle Beiträge Naturwissenschaft

Triebfeder – Unsicherheit und Angst

Unwissenheit, Wissensbeschaffung und das Wissen an sich können zu Unsicherheit und Angst führen, z. B.:

- die Fülle an (sich widersprechenden) Informationen kann überfordern;

- das Gefühl, mit seiner Meinung alleine dazustehen erzeugt Unsicherheit;

- das Wissen, auf eine kritische Situation keinen Einfluss zu haben, mündet in Angst.

Bei Angst und Unsicherheit gibt es 3 grundlegende Reaktionsmechanismen, mit denen man reagieren kann.

| Engl. Bezeichnung | Deutsche Bezeichnung | Beispiele für Umgang mit Unsicherheit / Angst |

|---|---|---|

| Flight | Flucht | Rückzug Geistige oder tatsächliche Abgrenzung zu der drohenden Gefahr; Suche nach Informationen, die die eigene Meinung unterstützen und abweichende Informationen negieren (s. u. Rückzug in Echokammern) |

| Fight | Kampf | Aktivität Projektion auf andere Objekte (unfähige Politiker, manipulierte Wissenschaftler) Suche nach weiteren Informationen und Versuch, diese stimmig einzuordnen (Gefahr: Verschwörungstheorien, s. u.) Unterstützen / Teilen von Informationen, die der eigenen Meinung entsprechen; herabwürdigen anderer Informationen und Meinungen |

| Freeze | Totstellen Einfrieren | Verleugnung Ignorieren von abweichenden Informationen; Verdrängen von bedrohenden Informationen; Herabstufung der Glaubwürdigkeit der Quelle mit abweichenden Informationen |

Internet – das Füllhorn des Wissens

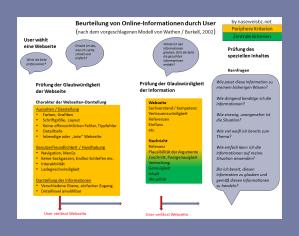

Das Internet ermöglicht es, Informationen zu nahezu jedem beliebigen Thema in unüberschaubarer Fülle zu erhalten. Viele der Informationen sind widersprüchlich. Es ist daher erforderlich, die angebotenen Informationen zu selektieren. Bereits bei dieser Auswahl greift der Mensch auf seine evolutionäre Basis zurück. Er wählt Informationsseiten zunächst nach peripheren Kriterien aus, bevor er sich den zentralen Kriterien widmet.

Doch bereits das Internet – die Suchmaschinen und sozialen Medien – filtern die angebotenen Informationen durch Algorithmen. Es werden etwa Informationen / Webseiten angezeigt, die zu dem jeweiligen User-Profil passen. Ebenso wird vorrangig angezeigt, was häufig gelesen, häufig geteilt oder kommentiert wurde, unabhängig von dem Wahrheitsgehalt. So werden Filterblasen erzeugt, die mit mehr oder weniger einseitigen Informationen gefüllt sind. Die genauen Algorithmen der Suchmaschinen sind im Detail nicht bekannt und unterscheiden sich zwischen den einzelnen Suchmaschinen und sozialen Medien.

Populisten – Meister der Manipulation

Populisten nutzen Unsicherheiten und die vereinfachenden Entscheidungskriterien, um Meinungen zu beeinflussen. Sie überfluten das Internet mit aussagekräftigen Bildern (Meme), kurzen einfachen Texten. Sie bieten scheinbar schnelle und einfache Lösungen für komplexe Probleme und bedienen festgefahrene Meinungen, sodass kein Umdenken erforderlich ist.

Home // Seitenanfang // Alle Beiträge Naturwissenschaft

Die Anderen – soziale Abkürzung

Bei komplexen Themen (oder für schnelle Entscheidungen) wird oft auf eine eigene unabhängige und zeitintensive Informationsbeschaffung verzichtet. Stattdessen wird auf Meinungen vertrauenswürdiger Personen zurückgegriffen. Diese Personen (Quellen), müssen bestimmte Kriterien erfüllen. Es wird dabei nicht unbedingt im Detail anhand zentraler Kriterien geprüft, ob diese Person glaubwürdig ist, sondern es werden vereinfachende (periphere) Kriterien verwendet.

Eine hohe Glaubwürdigkeit haben per se Personen, die aus dem direkten Umfeld (auch dem virtuellen) stammen. Kriterium ist hier also „persönliche Bekanntheit“ (Peer Group). Allerdings sind Personen im Internet in der Regel nicht persönlich bekannt. Das, was die Person im Internet darstellt, kann sich von deren realem Leben grundlegend unterscheiden.

Einige User kommentieren in Internet-Gruppen nahezu jeden Beitrag (sie werden zu Erkannten / Bekannten). Sie stellen sich als den Allwissenden dar, der nahezu jede Situation schon kennt und erlebt hat, jedes Buch zum Thema gelesen hat, jeden relevanten Experten persönlich kennt, die wohlerzogensten Kinder und Hunde besitzt, hohes soziales Engagement hat etc..

KI macht es möglich, dass massenweise Posts von scheinbar natürlichen Personen erzeugt werden. Insbesondere auf meinungsbildender politischer Ebene fluten diese Bots die sozialen Medien von Drittstaaten, um sie innenpolitisch zu destabilisieren (Cyber War).

Neben dieser persönlichen Ebene verwenden wir weitere vereinfachende „Glaubwürdigkeitskriterien“:

Wahrgenommene Kompetenz: Grad des empfundenen fachlichen Sachverstands.

Dieser lässt sich z. B. vortäuschen durch Verweis auf tatsächliche oder angebliche Quellen / Fachleute / Studien; Verwendung von Fachbegriffen; Darstellung von Fremdtexten als eigenes Wissen.

Unvoreingenommenheit: Neutralität, keine Parteilichkeit zugunsten einer Gruppe.

Diese Unvoreingenommenheit wird z. T. auf Randgruppen / Einzelpersonen ausgedehnt, die wissenschaftlich nicht anerkannt sind. Die wissenschaftliche Meinung sowie Medien, die diese Meinungen vertreten, werden dagegen als voreingenommen dargestellt.

Fairness: Anerkennung und angemessene Darstellung aller relevanten Standpunkte.

Häufig werden Aspekte zu einem Thema aufgeführt, die offizielle Seiten oder renommierte Medien nicht darstellen (und somit diese Darstellung als voreingenommen diskreditiert). Häufig sind diese Aspekte jedoch nur wissenschaftlich unbedeutende Einzelmeinungen, frei erfunden oder verzerrt wiedergegeben. Durch Mitteilung des „elitären“ Wissens erscheint das Gesagte als fair gegenüber dem Leser (und der Schreiber als kompetent).

Geradlinigkeit: Vorhersehbarkeit von Argumenten und Verhalten, welche auf der vorhergehenden Kommunikation beruht.

Vertritt jemand seine Meinung im Laufe verschiedener Diskussionen, ohne sich selbst zu widersprechen, gilt diese Person als glaubwürdig. Unberücksichtigt bleibt dabei ggf., dass diese eine festgefahrene, sture Meinung vertritt.

Aufrichtigkeit: Ehrlichkeit und Offenheit.

Hier können bestimmte Formulierungen Glaubwürdigkeit suggerieren, wie etwa „Ganz ehrlich….“, „Ich sags ungern, aber ganz offen….“

Empathie: Mitgefühl mit den Opfern eines potenziellen Schadens.

Populisten erklären oft den Leser selbst zum Opfer des Schadens („Anstieg der Kriminalität betrifft uns alle..“) und erreichen so dessen volle Aufmerksamkeit.

Engagement: Deutliches Zeichen für Entschlossenheit und guten Willen.

Wer viel postet, hat wohl etwas Wichtiges zu sagen (und nicht nur viel Zeit).

Die einzelnen Punkte können unterschiedlich gewichtet sein. Fehlt ein Kriterium, kann es durch ein anderes ausgeglichen werden. So kann Unvoreingenommenheit durch empfundene Fairness und den Glauben an Aufrichtigkeit ersetzt werden.

Flutet ein Bot unter einem Nickname immer wieder die sozialen Medien mit Nachrichten, die zwar in seriösen Medien enthalten, aber verzerrt sind, kann dies dazu führen, dass dieser Nick als vertrauenswürdig eingestuft wird. Die vereinfachenden Kriterien persönlich bekannt, Engagement, Kompetenz und ggf. weitere, wie Geradlinigkeit und Aufrichtigkeit, sind erfüllt.

Der Herdentrieb — Echokammern

Es gibt zahlreiche Experimente, die zeigen, dass Menschen sich davon beeinflussen lassen, was andere machen. Kognitive Dissonanz (Konflikte durch Unvereinbarkeit von Meinungen) entsteht dann, wenn die eigenen Meinungen sich stark von den Meinungen der anderen (insbesondere der Peer Group) unterscheiden oder neue Informationen nicht zu den bisherigen eigenen Informationen und Meinungen passen. Diese Dissonanz führt zu Unsicherheit und Angst. Der Meinungsunterschied wird ignoriert, abgewehrt oder heruntergespielt / klein gehalten. Informationen, die nicht mit den uns bereits bekannten übereinstimmen, werden bestenfalls verzerrt in das „Weltbild“ eingeordnet.

Im Internet bietet sich sehr einfach die Möglichkeit, sich mit Menschen „zu umgeben“, deren Meinungen den eigenen entsprechen. Indem man sich in diesen sogenannten Echokammern (z. B. in speziellen Gruppen in sozialen Medien) aufhält, kann man Meinungsabweichungen zu Anderen und daraus resultierende Unsicherheiten vermeiden. Wie bei einem Echo wird in den Echokammern die eigene Meinung von Gleichdenkenden zurückgeworfen und bestätigt. Die kognitive Dissonanz wird vermieden. Es ist nicht erforderlich, seine eigene Meinung zu überdenken oder gar zu ändern.

Home // Seitenanfang // Alle Beiträge Naturwissenschaft

Faustregeln – die geistigen Abkürzungen

Durch die innere Informationsverarbeitung werden aufgenommene Informationen sortiert, vereinfacht und eingeordnet. Zusammengefasst lassen sich 5 Mechanismen benennen, neue Informationen zu erfassen und dabei Unstimmigkeiten zu vermeiden (nach Renn):

Bestätigung (Pippi-Langstrumpf-Welt) ist die Tendenz, Informationen so zu ermitteln, auszuwählen und zu interpretieren, dass sie bestmöglich den eigenen Erwartungen und den bereits bekannten Informationen entsprechen.

Beispiel: Entschiedet man sich „aus dem Bauch heraus“ für den Kauf eines teuren Autos, werden logische Argumente erst im Nachhinein gesucht und gefunden. Informationen werden selektiv so ausgewählt, dass sie zu der getroffenen Entscheidung passen.

Rückzug in Echokammern.

Der Klimawandel erfordert Umdenken und gravierende Veränderungen. Stattdessen werden Informationen gewählt, die anscheinend beweisen, dass es keinen Klimawandel gibt.

Verfügbarkeit von bereits bekanntem Wissen: Gibt es bereits Erlebnisse / Erinnerungen an ähnliche Situationen oder neue Informationen decken sich mit dem, was man schon immer geglaubt hat (meinte zu wissen), werden diese neuen Informationen bevorzugt aufgenommen und behalten. Es wird geprüft, ob die neue Information in Zusammenhang mit den bekannten plausible ist.

Je öfter man eine Aussage liest, umso wahrscheinlicher wird sie als richtig eingestuft.

Gedankenanker bedeutet die Verwendung bekannter Eselsbrücken und Assoziationsketten, meist verbunden mit starken Vereinfachungen.

Unabhängig von der Maßeinheit, wirken hohe Zahlen mächtig (10000 m, 10 km).

Grafiken und Statistiken können durch das Layout trotz gleicher Aussage die Inhalte verzerren.

Die Wortwahl in Überschriften und Texten beeinflusst den Inhalt (Wirtschaftsasylanten, moslemische Flut, Impfzwang).

Repräsentativität beschreibt den Rückschluss aus (persönlichen oder von anderen geschilderten) Beobachtungen auf das Allgemeine. Hierbei bleiben zwei Dinge unberücksichtigt:

- Eigene Erfahrungen werden (statistisch) überbewertet.

- Oft liegt keine Kenntnis darüber vor, woher Dritte die Information haben. So können zahlreiche andere Menschen ihre Information aus der gleichen Quelle beziehen und unabhängig voneinander wiedergeben.

In verschiedenen Netzwerken werden immer wieder die gleichen Informationen geteilt, die letztendlich auf nur einer Quelle beruhen. Nimmt man diese Netzwerke jeweils als separate Quellen, erscheint das Informationsangebot unabhängiger Quellen groß. De facto basiert die Information nur auf einer Quelle.

Affektive Aufladung beinhaltet die emotionale Einstellung.

Insekten sind in Europa meist mit negativen Emotionen belegt. Das wirkt sich auf den Verzehr von Insekten als Alternative zu Fleisch aus. Der Schutz von Säugetieren ist den meisten Menschen wichtiger, als der Schutz von Insekten oder Amphibien.

Überschriften sprechen oft gezielt Emotionen an (Mord, Panik).

Populisten betonen gezielt emotional aufgeladene, Angst machende Aspekte.

Reingefallen – Wahrnehmungsfehler

Diese Faustregeln sowie weitere gedankliche Vereinfachungen und Fehlinterpretationen führen zu Wahrnehmungsfehlern. Einige davon sind nachfolgend aufgelistet.

Confirmation Bias: Anpassung der aufgenommenen Informationen an die eigenen Vorstellungen. Dies ist einer der wichtigsten Wahrnehmungsfehler. (Beispiele s. o.).

Ist man der Überzeugung, dass bei Ausländern eine höhere Kriminalitätsrate existiert, fallen besonders Meldungen auf, die das bestätigen.

Aus einem neutralen Gesamttext über einen Politiker, den man für unfähig hält, werden die negativen Aspekte behalten. Bei einem für fähig gehaltenen Politiker, die positiven.

Politiker, die die eigenen Meinungen bestätigen, werden eher gewählt, selbst wenn sie an sich wenig qualifiziert sind.

Rückschaufehler / Hindsight Bias: Ursprüngliche Einschätzungen eines Ereignisses werden im Rückblick revidiert und angepasst. Nach dem Ereignis wird also die eigene Meinung rückwirkend angepasst, um kognitive Dissonanz zu vermeiden (Beispiel siehe auch oben: Bestätigung).

„Das hab ich doch schon immer gesagt!“. – auch wenn bekannt ist, dass derjenige bisher völlig anderer Meinung war.

Framing-Effekt: Je nach Darstellung der Information (Wortwahl, Satzbau etc.) werden bei gleichem Informationsinhalt die Informationen unterschiedlich eingestuft.

Gemäß der Neue Erwartungstheorie (prospect theory) bevorzugen Menschen sichere Gewinne vor unsicheren und vermeiden Verluste. Je nachdem, wie die gleiche Situation beschrieben wird, können unterschiedliche Reaktionen erzeugt werden.

Es ist ein Unterschied, ob bei 600 Betroffenen von 200 Getöteten oder von 400 Geretteten gesprochen wird (und umgekehrt).

Clustering-illusion: Menschen erkennen Muster, auch wenn diese de facto nicht vorhanden sind. Aus einer Reihe von Ereignissen wird etwa ein „immer wenn“, unabhängig von den Umgebungsbedingungen konstruiert.

Auf diesem Phänomen basiert z. B. Aberglaube („Wenn ich das rote T-Shirt trage, habe ich Erfolg.“), aber auch Fehlglaube („Störche bringen Kinder“, „Alle Ausländer sind kriminell“). In Verschwörungstheorien werden unzusammenhängende Ereignisse und Umstände in einen scheinbar logischen Zusammenhang gefügt.

Primäreffekt / Rezenzeffekt: zuletzt bzw. zuerst erhaltene Informationen werden am besten erinnert. Der erste Eindruck, die erste Information kann als bleibender Anker erhalten bleiben. Andererseits sind später erhaltene Informationen im Kurzzeitgedächtnis enthalten. Treten hier gehäuft Informationen auf, die den ursprünglichen (ersten) widersprechen, kann die Meinung geändert werden. Dies kann jedoch auch zu internen Widersprüchen (kognitive Dissonanz) führen, die ignoriert werden (müssen).

Selbstüberschätzung: Überschätzung des eigenen Wissens und Könnens.

Tendenziell überschätzen sich Männer, während Frauen sich unterschätzen.

Eine Steigerung ist der Mount-Stupid-Effekt (oder Dunning-Kruger-Effekt): Wer (sehr) wenig über eine Sache weiß, hat mit höherer Wahrscheinlichkeit großes Vertrauen in sein eigenes Wissen und Urteilsvermögen.

Menschen mit geringerer Schulbildung glauben tendenziell eher an Verschwörungstheorien. Damit einhergehend ist der Glaube, dass sie „den vollen Durchblick haben“ und über elitäres Wissen verfügen.

Während Corona fühlten sich zahlreiche Menschen als Experten für Virologie und Pandemie, obwohl sie sich vorab noch nie mit diesen Themen auseinandergesetzt hatten und ihr Wissen bei weitem nicht reichte, um kompetent zu sein.

Negativitätsverzerrung: Negative Erfahrungen wirken stärker als positive (oder das Erwartete). Negative eigene Erfahrungen / Informationen werden höher bewertet (und gleich lautende eher wahrgenommen) als positive Erfahrungen / Informationen. Eine negative Erfahrung (oder Enttäuschung) kann somit zu einem „immer“ werden. Teilweise reichen schon wenige negative Erfahrungen aus, um das Gesamte falsch zu beurteilen.

Treten nach einer Impfung negative Nebenwirkungen auf (unabhängig, ob diese mit der Impfung tatsächlich in Zusammenhang stehen), werden Impfungen als negativ und gefährlich eingestuft.

Dritt-Personen-Effekt (Third-person-effect): Menschen gehen davon aus, dass Wahrnehmungsverzerrungen lediglich bei anderen auftreten, sie selbst aber nicht davon betroffen sind.

Plausibilitätsidee: Wenn etwas als plausibel empfunden wird, wird es eher geglaubt. Die Plausibilität ist u. a. stark von dem vorhandenen Detailwissen abhängig. Werden die einzelnen Argumente als plausible akzeptiert, ist die Wahrscheinlichkeit groß, dass die gesamte Konzeption als plausibel bewertet wird (und umgekehrt).

Fake News und Falschmeldungen enthalten zum Teil einen wahren Kern, sind jedoch im Gesamtzusammenhang falsch dargestellt. Der wahre Kern kann dazu verleiten, die gesamte Meldung als wahr einzustufen.

Posts, Meldungen, Veröffentlichungen denen nicht widersprochen wird, werden als glaubwürdig eingestuft.

Beispiele von zum Teil falschen, widersprüchlichen, aber plausibel eingestuften Einzelargumente, die die Gesamttheorie glaubhaft erscheinen lassen: Klimawandel gab es schon immer. Extremwetter gab es schon immer. Der geringe Anstieg des CO2 in der Atmosphäre kann unmögliche solche Auswirkungen haben. Niemand kann mit Sicherheit sagen, dass der Mensch die Änderungen verursacht hat. Klimamaßnahmen in einem einzigen Land haben keinen weltweiten Einfluss. Gesamttheorie: Es gibt keinen menschengemachten Klimawandel und somit sind auch keine einschränkenden Maßnahmen erforderlich.

Home // Seitenanfang // Alle Beiträge Naturwissenschaft

Statistik – das unbekannte Wesen

Der Mensch ist ein sehr schlechter (intuitiver) Statistiker. Entsprechend groß sind die Fehler und Fehlinterpretationen (auch in renommierten Medien). Andererseits werden Aussagen z. T. bewusst irreführend dargestellt.

Eine Steigerung um 100 % hört sich riesig an. Tatsächlich kann es aber sein, dass von 100 Personen zuvor nur eine Person ein Merkmal (z. B. eine Erkrankung) aufwies, anschließend 2 Personen. Statistisch kann diese Steigerung ggf. in den Bereich des Zufälligen fallen. Die Aussage Steigerung von 1 % auf 2 % wirkt dagegen sehr viel weniger alarmierend.

Ein typischer Fehler ist der Basisratenfehler (Prävalenzfehler), also der Vergleich„von Äpfeln mit Birnen“.

Möchte man eine Aussage über die Kriminalitätsrate einer bestimmten abgegrenzten Personengruppe treffen (z. B. Asylbewerber), kann man diese nur mit der Kriminalitätsrate einer vergleichbaren Gruppe aus der Grundgesamtheit (der Bevölkerung Deutschlands) vergleichen: Also Personen mit ähnlichem Alter, Bildungsgrad, Geschlecht, Einkommen, Wohnverhältnissen etc. Bei einem Vergleich mit der Kriminalitätsrate der gesamten Bevölkerung, treten Verzerrung auf. So sind z. B. ältere Menschen grundsätzlich weniger häufig kriminell, ebenso Frauen im Verhältnis zu Männern. In sozialen Brennpunkten ist die Rate an Kapitalverbrechen oder bestimmter sozialen Verbrechen höher, als auf dem Land oder in einem Villenviertel.

Wissenschaft stochert im Dunklen

Ein großes Problem komplexer Themen ist, dass zahlreiche Faktoren einwirken und die exakte Beschreibung und die Vorhersage eines exakten Ablaufes nahezu unmöglich sind. Die Aussagen zu komplexen Themen können nur mit einer gewissen Wahrscheinlichkeit getroffen werden (stochastische Vorhersagen).

Die Größe von erwachsenen Menschen liegt innerhalb einer Spanne von 150 – ca. 200 cm, wobei sich die Körpergröße von Männern und Frauen unterscheidet, es regionale Unterschiede gibt, sich die Durchschnittsgrößen im Laufe der Zeit verändern und es deutlich kleinere und größere Menschen gibt. Der durchschnittliche Mann in Westeuropa ist 180 cm, die durchschnittliche Frau 166 cm groß. Weiß man, dass gleich ein Mensch den Raum betritt, kann vorab keine genaue Aussage gemacht, wie groß dieser Mensch ist. Weiß man, dass es eine Frau ist, liegt deren Größe mit einer Wahrscheinlichkeit von 50 % zwischen 160 und 170 cm oder mit 90 % Wahrscheinlichkeit zwischen 155 und 174 cm. Mit 10 % Wahrscheinlichkeit kann die Größe der Frau jedoch < 155 cm oder > 174 cm sein. Die Aussage „Mit hoher Wahrscheinlichkeit zwischen 155 und 174 cm“ ist deswegen jedoch nicht falsch.

Der Klimawandel ist mit hoher Wahrscheinlichkeit durch den Menschen gemacht. Mit hoher Wahrscheinlichkeit ist innerhalb einer Zeitspanne von x mit den Folgen y zu rechnen. Kipp-Punkte, ab denen sich der Klimawandel stark beschleunigt und es entweder nicht mehr oder nur noch mit extrem hohem Aufwand möglich ist den Wandel zu stoppen, werden wahrscheinlich erreicht, wenn….

Vorhersagen des „Club of Rome“ zur Endlichkeit der Ressourcen: Unter der im Jahre 1972 bekannten Informationen wurden Vorhersagen getroffen, wann Öl, Gas und andere Ressourcen erschöpft sind. Durch verbesserte Fördermöglichkeiten, neu entdeckte Ressourcen und erhöhte Risikobereitschaft der Weltgemeinschaft haben sich die exakten Jahresangaben als falsch erwiesen. Dies ändert jedoch nichts an der Endlichkeit der Ressourcen (die das eigentliche Thema des Berichtes waren).

Bei diesen Themen steht also lediglich fest, dass sie eintreten (vorhanden sind). Eine genaue Beschreibung ist jedoch nicht möglich. Diese „vagen“ Beschreibungen bedeuten nicht, dass diese Ereignisse nicht eintreten, die Beschreibungen falsch sind oder die Wissenschaft unzuverlässig ist. Es wäre auch falsch, statt auf die sehr wahrscheinlichen Abläufe aufzubauen, auf das Eintreten der weniger wahrscheinlichen zu vertrauen.

Insbesondere Populisten argumentieren jedoch häufig mit den eher unwahrscheinlichen Abläufen.

Der Klimawandel ist nicht Menschen gemacht, Klimaveränderungen treten bestenfalls in 100 Jahren auf und bis dahin hat die Menschheit ausreichend Technologien zur Verfügung, wir müssen uns wegen des Klimas in keiner Weise einschränken. Klimaextreme gab es schon immer.

Jeder ist seines Glückes Schmid

Wir alle neigen dazu, schnell eine Meinung auf Basis von unzureichendem Wissens zu fällen. Bei der Informationsbeschaffung tendieren wir dazu, einseitige Informationen, die „uns gefallen“ zu behalten und dem widersprechende Informationen zu ignorieren. Populisten nutzten diese Tendenz.

Insbesondere im Internet finden sich zahlreiche Informationen, die jede beliebige Meinung widerspiegeln. Das Internet bietet die Gelegenheit, sich Informationen und Kommunikationspartner zu suchen, die zu den eigenen Überzeugungen bestmöglich passen und ein Umdenken nicht erforderlich machen.

Nur wer die oben genannten Mechanismen kennt und sich immer wieder selbst prüft, kann vermeiden, von Populisten beeinflusst zu werden, auf Manipulationen hereinzufallen und grobe Fehlentscheidungen zu treffen.

Zusätzlich hilft Medienkompetenz dabei, Informationsquellen und Informationen richtig einzuordnen.

Literaturtipps und Quellen

Ortwin Renn: Gefühlte Wahrheiten – Orientierung in Zeiten postfaktischer Wahrheiten

Hans Rosling, Anna Rosling Rönnlund, Ola Rosling: Factfulness: Wie wir lernen, die Welt so zu sehen, wie sie wirklich ist

Wathen CN, Burkell J: Beleive it or not: Factors influencing credibility on the Web. Journal oft he American Society for Information Science and Technology, 53(2):134–144, 2002

Risiken der Informationsgesellschaft

Home // Seitenanfang // Alle Beiträge Naturwissenschaft

naseweisbz.net